網絡爬蟲,是在網上進行數據抓取的程序,使用它能夠抓取特定網頁的HTML數據。雖然我們利用一些庫開發一個爬蟲程序,但是使用框架可以大大提高效率,縮短開發時間。Scrapy是一個使用Python編寫的,輕量級的,簡單輕巧,並且使用起來非常的方便。使用Scrapy可以很方便的完成網上數據的采集工作,它為我們完成了大量的工作,而不需要自己費大力氣去開發。

首先先要回答一個問題。

問:把網站裝進爬蟲裡,總共分幾步?

答案很簡單,四步:

新建項目 (Project):新建一個新的爬蟲項目

明確目標(Items):明確你想要抓取的目標

制作爬蟲(Spider):制作爬蟲開始爬取網頁

存儲內容(Pipeline):設計管道存儲爬取內容

好的,基本流程既然確定了,那接下來就一步一步的完成就可以了。

1.新建項目(Project)

在空目錄下按住Shift鍵右擊,選擇“在此處打開命令窗口”,輸入一下命令:

代碼如下:

scrapy startproject tutorial

其中,tutorial為項目名稱。

可以看到將會創建一個tutorial文件夾,目錄結構如下:

代碼如下:

tutorial/

scrapy.cfg

tutorial/

__init__.py

items.py

pipelines.py

settings.py

spiders/

__init__.py

...

下面來簡單介紹一下各個文件的作用:

scrapy.cfg:項目的配置文件

tutorial/:項目的Python模塊,將會從這裡引用代碼

tutorial/items.py:項目的items文件

tutorial/pipelines.py:項目的pipelines文件

tutorial/settings.py:項目的設置文件

tutorial/spiders/:存儲爬蟲的目錄

2.明確目標(Item)

在Scrapy中,items是用來加載抓取內容的容器,有點像Python中的Dic,也就是字典,但是提供了一些額外的保護減少錯誤。

一般來說,item可以用scrapy.item.Item類來創建,並且用scrapy.item.Field對象來定義屬性(可以理解成類似於ORM的映射關系)。

接下來,我們開始來構建item模型(model)。

首先,我們想要的內容有:

名稱(name)

鏈接(url)

描述(description)

修改tutorial目錄下的items.py文件,在原本的class後面添加我們自己的class。

因為要抓dmoz.org網站的內容,所以我們可以將其命名為DmozItem:

代碼如下:

# Define here the models for your scraped items

#

# See documentation in:

# http://doc.scrapy.org/en/latest/topics/items.html

from scrapy.item import Item, Field

class TutorialItem(Item):

# define the fields for your item here like:

# name = Field()

pass

class DmozItem(Item):

title = Field()

link = Field()

desc = Field()

剛開始看起來可能會有些看不懂,但是定義這些item能讓你用其他組件的時候知道你的 items到底是什麼。

可以把Item簡單的理解成封裝好的類對象。

3.制作爬蟲(Spider)

制作爬蟲,總體分兩步:先爬再取。

也就是說,首先你要獲取整個網頁的所有內容,然後再取出其中對你有用的部分。

3.1爬

Spider是用戶自己編寫的類,用來從一個域(或域組)中抓取信息。

他們定義了用於下載的URL列表、跟蹤鏈接的方案、解析網頁內容的方式,以此來提取items。

要建立一個Spider,你必須用scrapy.spider.BaseSpider創建一個子類,並確定三個強制的屬性:

name:爬蟲的識別名稱,必須是唯一的,在不同的爬蟲中你必須定義不同的名字。

start_urls:爬取的URL列表。爬蟲從這裡開始抓取數據,所以,第一次下載的數據將會從這些urls開始。其他子URL將會從這些起始URL中繼承性生成。

parse():解析的方法,調用的時候傳入從每一個URL傳回的Response對象作為唯一參數,負責解析並匹配抓取的數據(解析為item),跟蹤更多的URL。

這裡可以參考寬度爬蟲教程中提及的思想來幫助理解,教程傳送:[Java] 知乎下巴第5集:使用HttpClient工具包和寬度爬蟲。

也就是把Url存儲下來並依此為起點逐步擴散開去,抓取所有符合條件的網頁Url存儲起來繼續爬取。

下面我們來寫第一只爬蟲,命名為dmoz_spider.py,保存在tutorial\spiders目錄下。

dmoz_spider.py代碼如下:

代碼如下:

from scrapy.spider import Spider

class DmozSpider(Spider):

name = "dmoz"

allowed_domains = ["dmoz.org"]

start_urls = [

"http://www.dmoz.org/Computers/Programming/Languages/Python/Books/",

"http://www.dmoz.org/Computers/Programming/Languages/Python/Resources/"

]

def parse(self, response):

filename = response.url.split("/")[-2]

open(filename, 'wb').write(response.body)

allow_domains是搜索的域名范圍,也就是爬蟲的約束區域,規定爬蟲只爬取這個域名下的網頁。

從parse函數可以看出,將鏈接的最後兩個地址取出作為文件名進行存儲。

然後運行一下看看,在tutorial目錄下按住shift右擊,在此處打開命令窗口,輸入:

代碼如下:

scrapy crawl dmoz

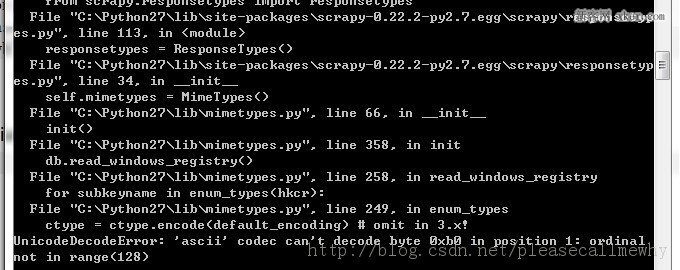

運行結果如圖:

報錯了:

UnicodeDecodeError: 'ascii' codec can't decode byte 0xb0 in position 1: ordinal not in range(128)

運行第一個Scrapy項目就報錯,真是命運多舛。

應該是出了編碼問題,谷歌了一下找到了解決方案:

在python的Lib\site-packages文件夾下新建一個sitecustomize.py:

代碼如下:

import sys

sys.setdefaultencoding('gb2312')

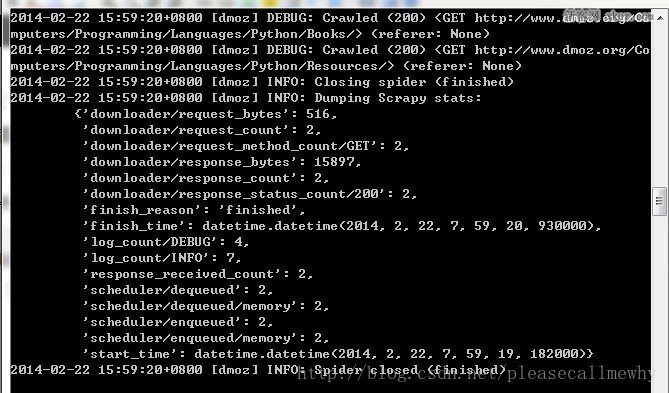

再次運行,OK,問題解決了,看一下結果:

最後一句INFO: Closing spider (finished)表明爬蟲已經成功運行並且自行關閉了。

包含 [dmoz]的行 ,那對應著我們的爬蟲運行的結果。

可以看到start_urls中定義的每個URL都有日志行。

還記得我們的start_urls嗎?

http://www.dmoz.org/Computers/Programming/Languages/Python/Books

http://www.dmoz.org/Computers/Programming/Languages/Python/Resources

因為這些URL是起始頁面,所以他們沒有引用(referrers),所以在它們的每行末尾你會看到 (referer: )。

在parse 方法的作用下,兩個文件被創建:分別是 Books 和 Resources,這兩個文件中有URL的頁面內容。

那麼在剛剛的電閃雷鳴之中到底發生了什麼呢?

首先,Scrapy為爬蟲的 start_urls屬性中的每個URL創建了一個 scrapy.http.Request 對象 ,並將爬蟲的parse 方法指定為回調函數。

然後,這些 Request被調度並執行,之後通過parse()方法返回scrapy.http.Response對象,並反饋給爬蟲。

3.2取

爬取整個網頁完畢,接下來的就是的取過程了。

光存儲一整個網頁還是不夠用的。

在基礎的爬蟲裡,這一步可以用正則表達式來抓。

在Scrapy裡,使用一種叫做 XPath selectors的機制,它基於 XPath表達式。

如果你想了解更多selectors和其他機制你可以查閱資料:點我點我

這是一些XPath表達式的例子和他們的含義

/html/head/title: 選擇HTML文檔

元素下面的

為了方便使用XPaths,Scrapy提供XPathSelector 類,有兩種可以選擇,HtmlXPathSelector(HTML數據解析)和XmlXPathSelector(XML數據解析)。

必須通過一個 Response 對象對他們進行實例化操作。

你會發現Selector對象展示了文檔的節點結構。因此,第一個實例化的selector必與根節點或者是整個目錄有關 。

在Scrapy裡面,Selectors 有四種基礎的方法(點擊查看API文檔):

xpath():返回一系列的selectors,每一個select表示一個xpath參數表達式選擇的節點

css():返回一系列的selectors,每一個select表示一個css參數表達式選擇的節點

extract():返回一個unicode字符串,為選中的數據

re():返回一串一個unicode字符串,為使用正則表達式抓取出來的內容

3.3xpath實驗

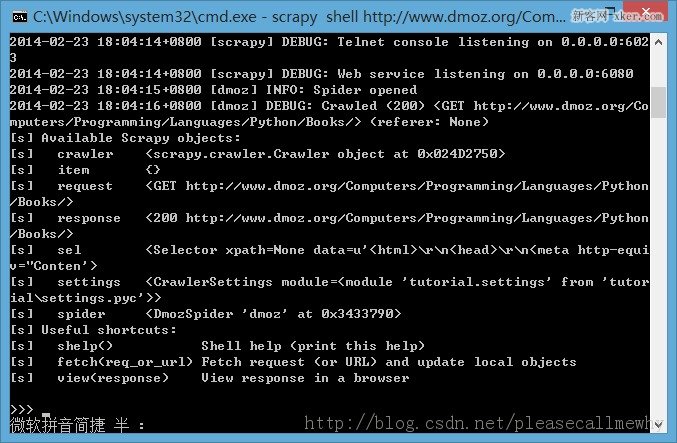

下面我們在Shell裡面嘗試一下Selector的用法。

實驗的網址:http://www.dmoz.org/Computers/Programming/Languages/Python/Books/

熟悉完了實驗的小白鼠,接下來就是用Shell爬取網頁了。

進入到項目的頂層目錄,也就是第一層tutorial文件夾下,在cmd中輸入:

代碼如下:

scrapy shell http://www.dmoz.org/Computers/Programming/Languages/Python/Books/

回車後可以看到如下的內容:

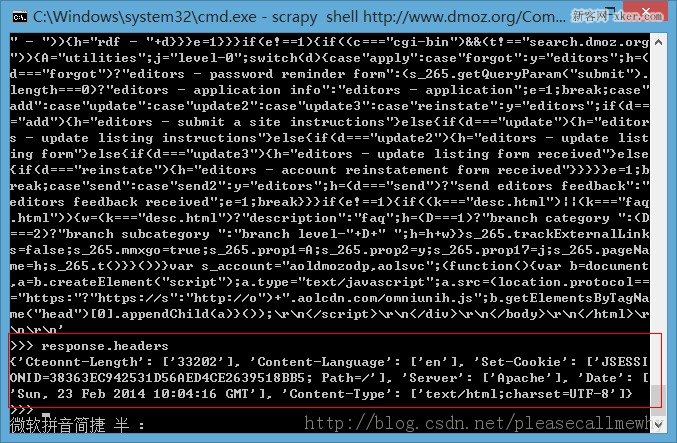

在Shell載入後,你將獲得response回應,存儲在本地變量 response中。

所以如果你輸入response.body,你將會看到response的body部分,也就是抓取到的頁面內容:

或者輸入response.headers 來查看它的 header部分:

現在就像是一大堆沙子握在手裡,裡面藏著我們想要的金子,所以下一步,就是用篩子搖兩下,把雜質出去,選出關鍵的內容。

selector就是這樣一個篩子。

在舊的版本中,Shell實例化兩種selectors,一個是解析HTML的 hxs 變量,一個是解析XML 的 xxs 變量。

而現在的Shell為我們准備好的selector對象,sel,可以根據返回的數據類型自動選擇最佳的解析方案(XML or HTML)。

然後我們來搗弄一下!~

要徹底搞清楚這個問題,首先先要知道,抓到的頁面到底是個什麼樣子。

比如,我們要抓取網頁的標題,也就是

可以輸入:

代碼如下:

sel.xpath('//title')

結果就是:

這樣就能把這個標簽取出來了,用extract()和text()還可以進一步做處理。

備注:簡單的羅列一下有用的xpath路徑表達式:

表達式 描述

nodename 選取此節點的所有子節點。

/ 從根節點選取。

// 從匹配選擇的當前節點選擇文檔中的節點,而不考慮它們的位置。

. 選取當前節點。

.. 選取當前節點的父節點。

@ 選取屬性。

全部的實驗結果如下,In[i]表示第i次實驗的輸入,Out[i]表示第i次結果的輸出(建議大家參照:W3C教程):

代碼如下:

In [1]: sel.xpath('//title')

Out[1]: [Open Directory - Computers: Progr'>]

In [2]: sel.xpath('//title').extract()

Out[2]: [u'']

In [3]: sel.xpath('//title/text()')

Out[3]: []

In [4]: sel.xpath('//title/text()').extract()

Out[4]: [u'Open Directory - Computers: Programming: Languages: Python: Books']

In [5]: sel.xpath('//title/text()').re('(\w+):')

Out[5]: [u'Computers', u'Programming', u'Languages', u'Python']

當然title這個標簽對我們來說沒有太多的價值,下面我們就來真正抓取一些有意義的東西。

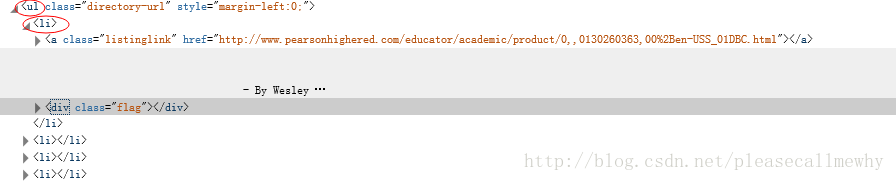

使用火狐的審查元素我們可以清楚地看到,我們需要的東西如下:

我們可以用如下代碼來抓取這個

標簽:

代碼如下:

sel.xpath('//ul/li')

從

標簽中,可以這樣獲取網站的描述:

代碼如下:

sel.xpath('//ul/li/text()').extract()

可以這樣獲取網站的標題:

代碼如下:

sel.xpath('//ul/li/a/text()').extract()

可以這樣獲取網站的超鏈接:

代碼如下:

sel.xpath('//ul/li/a/@href').extract()

當然,前面的這些例子是直接獲取屬性的方法。

我們注意到xpath返回了一個對象列表,

那麼我們也可以直接調用這個列表中對象的屬性挖掘更深的節點

(參考:Nesting selectors andWorking with relative XPaths in the Selectors):

sites = sel.xpath('//ul/li')

for site in sites:

title = site.xpath('a/text()').extract()

link = site.xpath('a/@href').extract()

desc = site.xpath('text()').extract()

print title, link, desc

3.4xpath實戰

我們用shell做了這麼久的實戰,最後我們可以把前面學習到的內容應用到dmoz_spider這個爬蟲中。

在原爬蟲的parse函數中做如下修改:

代碼如下:

from scrapy.spider import Spider

from scrapy.selector import Selector

class DmozSpider(Spider):

name = "dmoz"

allowed_domains = ["dmoz.org"]

start_urls = [

"http://www.dmoz.org/Computers/Programming/Languages/Python/Books/",

"http://www.dmoz.org/Computers/Programming/Languages/Python/Resources/"

]

def parse(self, response):

sel = Selector(response)

sites = sel.xpath('//ul/li')

for site in sites:

title = site.xpath('a/text()').extract()

link = site.xpath('a/@href').extract()

desc = site.xpath('text()').extract()

print title

注意,我們從scrapy.selector中導入了Selector類,並且實例化了一個新的Selector對象。這樣我們就可以像Shell中一樣操作xpath了。

我們來試著輸入一下命令運行爬蟲(在tutorial根目錄裡面):

代碼如下:

scrapy crawl dmoz

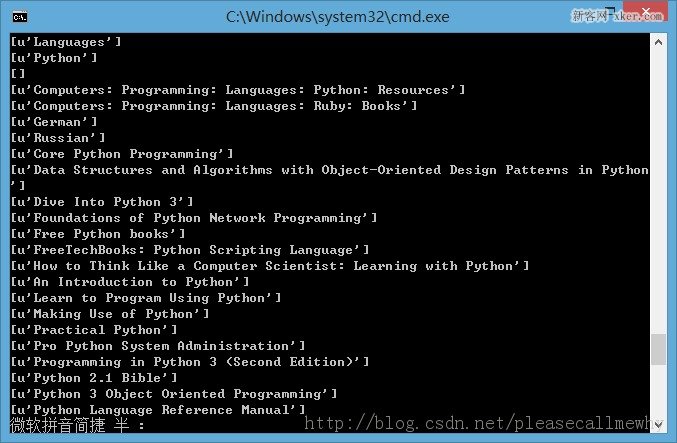

運行結果如下:

果然,成功的抓到了所有的標題。但是好像不太對啊,怎麼Top,Python這種導航欄也抓取出來了呢?

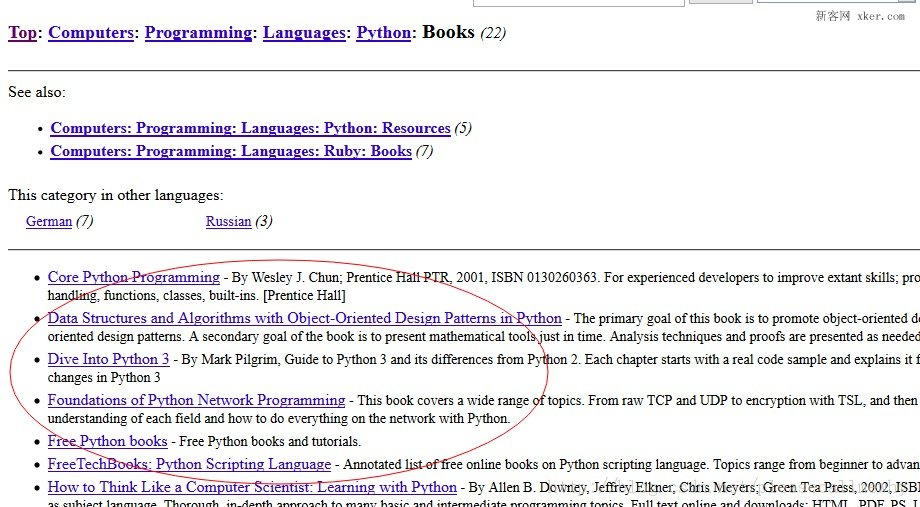

我們只需要紅圈中的內容:

看來是我們的xpath語句有點問題,沒有僅僅把我們需要的項目名稱抓取出來,也抓了一些無辜的但是xpath語法相同的元素。

審查元素我們發現我們需要的

具有class='directory-url'的屬性,

那麼只要把xpath語句改成sel.xpath('//ul[@class="directory-url"]/li')即可

將xpath語句做如下調整:

代碼如下:

from scrapy.spider import Spider

from scrapy.selector import Selector

class DmozSpider(Spider):

name = "dmoz"

allowed_domains = ["dmoz.org"]

start_urls = [

"http://www.dmoz.org/Computers/Programming/Languages/Python/Books/",

"http://www.dmoz.org/Computers/Programming/Languages/Python/Resources/"

]

def parse(self, response):

sel = Selector(response)

sites = sel.xpath('//ul[@class="directory-url"]/li')

for site in sites:

title = site.xpath('a/text()').extract()

link = site.xpath('a/@href').extract()

desc = site.xpath('text()').extract()

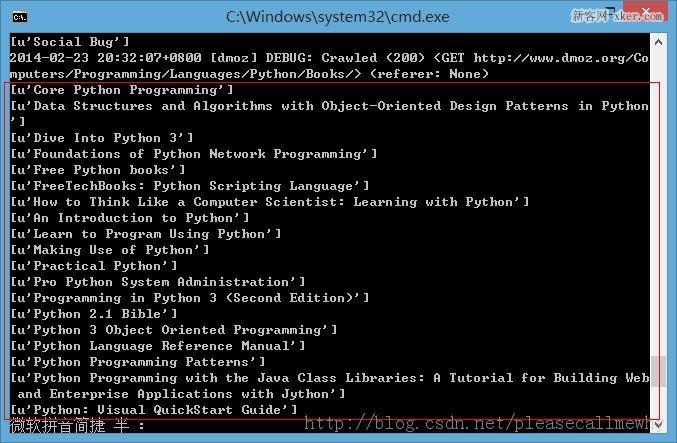

print title

成功抓出了所有的標題,絕對沒有濫殺無辜:

3.5使用Item

接下來我們來看一看如何使用Item。

前面我們說過,Item 對象是自定義的python字典,可以使用標准字典語法獲取某個屬性的值:

代碼如下:

>>> item = DmozItem()

>>> item['title'] = 'Example title'

>>> item['title']

'Example title'

作為一只爬蟲,Spiders希望能將其抓取的數據存放到Item對象中。為了返回我們抓取數據,spider的最終代碼應當是這樣:

代碼如下:

from scrapy.spider import Spider

from scrapy.selector import Selector

from tutorial.items import DmozItem

class DmozSpider(Spider):

name = "dmoz"

allowed_domains = ["dmoz.org"]

start_urls = [

"http://www.dmoz.org/Computers/Programming/Languages/Python/Books/",

"http://www.dmoz.org/Computers/Programming/Languages/Python/Resources/"

]

def parse(self, response):

sel = Selector(response)

sites = sel.xpath('//ul[@class="directory-url"]/li')

items = []

for site in sites:

item = DmozItem()

item['title'] = site.xpath('a/text()').extract()

item['link'] = site.xpath('a/@href').extract()

item['desc'] = site.xpath('text()').extract()

items.append(item)

return items

4.存儲內容(Pipeline)

保存信息的最簡單的方法是通過Feed exports,主要有四種:JSON,JSON lines,CSV,XML。

我們將結果用最常用的JSON導出,命令如下:

代碼如下:

scrapy crawl dmoz -o items.json -t json

-o 後面是導出文件名,-t 後面是導出類型。

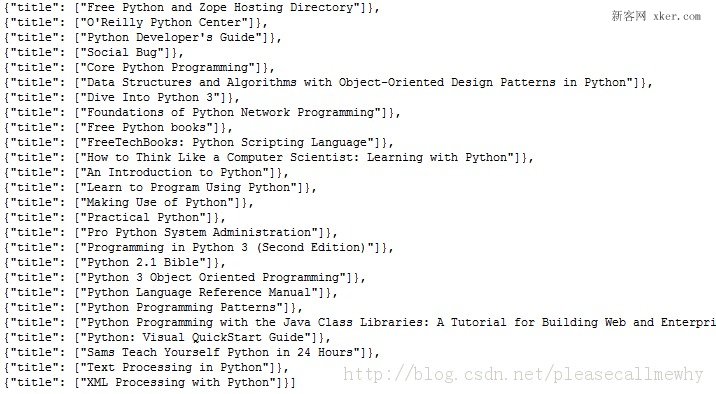

然後來看一下導出的結果,用文本編輯器打開json文件即可(為了方便顯示,在item中刪去了除了title之外的屬性):

因為這個只是一個小型的例子,所以這樣簡單的處理就可以了。

如果你想用抓取的items做更復雜的事情,你可以寫一個 Item Pipeline(條目管道)。

這個我們以後再慢慢玩^_^

以上便是python爬蟲框架Scrapy制作爬蟲抓取網站內容的全部過程了,非常的詳盡吧,希望能夠對大家有所幫助,有需要的話也可以和我聯系,一起進步